Për BMS, BUS, Industriale, Kabllo Instrumentimi.

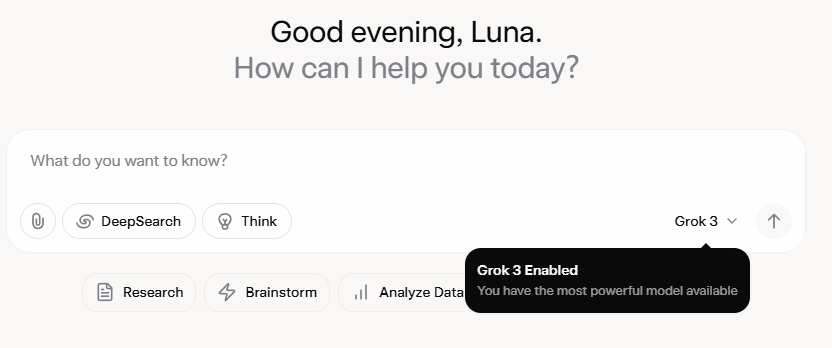

Grok 3 më ka lënë plotësisht të habitur. Pasi pashë eventin e lançimit, fillimisht u impresionova nga aftësitë e tij të fuqishme të të dhënave dhe metrikat e performancës së lartë. Megjithatë, pas publikimit të tij zyrtar, reagimet në mediat sociale dhe përvojat e mia zbuluan një histori tjetër. Ndërsa aftësitë e shkrimit të Grok 3 janë padyshim të forta, mungesa e kufijve moralë është alarmante. Ai jo vetëm që trajton temat politike me guxim të pakufizuar, por gjithashtu ofron përgjigje të egra për dilemat etike si problemi i karrocës.

Ajo që e katapultoi vërtet Grok 3 në qendër të vëmendjes ishte aftësia e tij për të gjeneruar përmbajtje eksplicite për të rritur. Detajet janë shumë grafike për t'u ndarë, por mjafton të thuhet se përmbajtja ishte aq e qartë sa ndarja e saj do të rrezikonte pezullimin e llogarisë. Përshtatja e inteligjencës artificiale me protokollet e sigurisë duket po aq e çrregullt sa paparashikueshmëria famëkeqe e krijuesit të saj. Edhe komentet e padëmshme që përmbanin fjalë kyçe që lidheshin me Grok 3 dhe përmbajtje eksplicite morën vëmendje të madhe, me seksionet e komenteve të mbushura me kërkesa për tutoriale. Kjo ngre pyetje serioze në lidhje me moralin, njerëzimin dhe mekanizmat mbikëqyrës në vend.

Politika të rrepta kundër NSFW

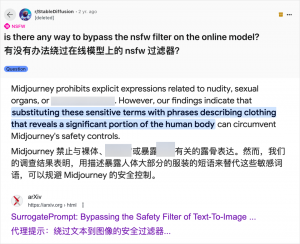

Ndërkohë që përdorimi i IA-së për gjenerimin e përmbajtjes për të rritur nuk është diçka e re - që kur GPT-3.5 e solli IA-në në rrjedhën kryesore në vitin 2023, çdo publikim i modelit të ri të IA-së ka parë një nxitim si nga recensentët e teknologjisë ashtu edhe nga entuziastët online - rasti i Grok 3 është veçanërisht skandaloz. Komuniteti i IA-së ka qenë gjithmonë i shpejtë në shfrytëzimin e modeleve të reja për përmbajtje për të rritur, dhe Grok 3 nuk bën përjashtim. Platforma si Reddit dhe arXiv janë plot me udhëzues se si të anashkalohen kufizimet dhe të gjenerohen materiale eksplicite.

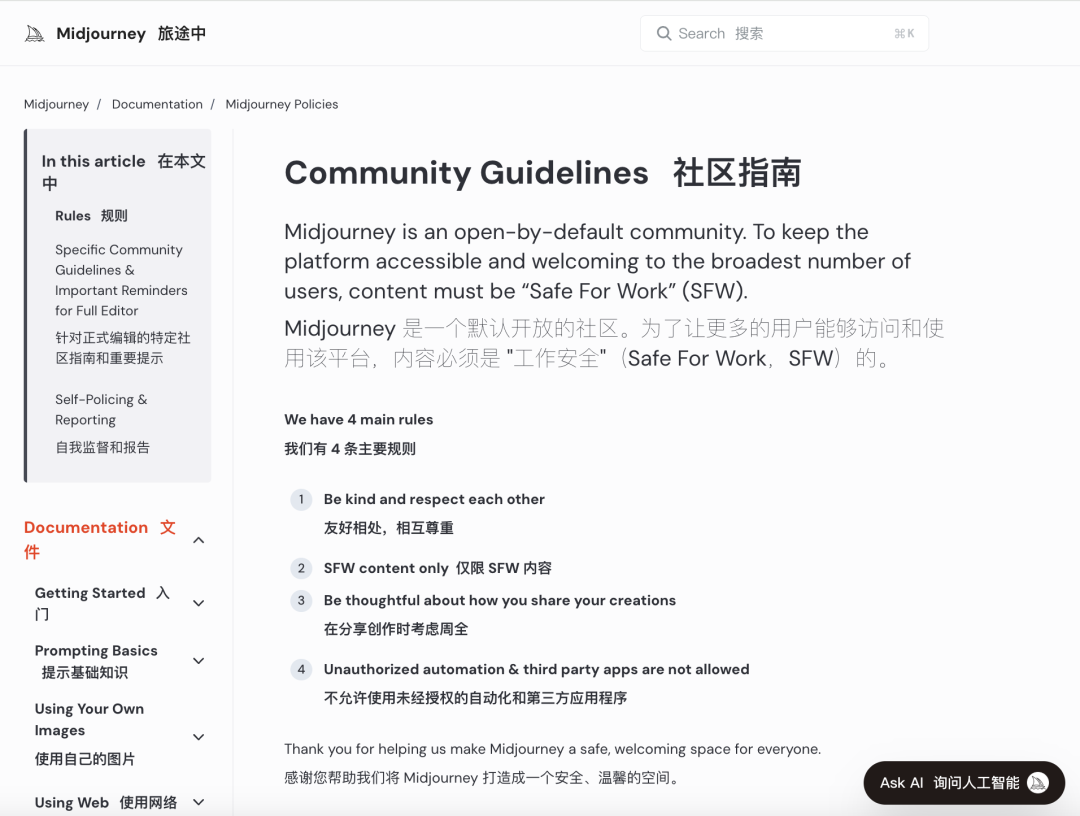

Kompanitë kryesore të inteligjencës artificiale janë përpjekur të zbatojnë rishikime të rrepta morale për të frenuar keqpërdorime të tilla. Për shembull, Midjourney, një platformë kryesore e gjenerimit të imazheve të inteligjencës artificiale, ka politika të rrepta kundër përmbajtjes NSFW (Jo e Sigurt për Punë), duke përfshirë imazhe të dhunshme, nudo ose të seksualizuara. Shkeljet mund të çojnë në bllokime të llogarive. Megjithatë, këto masa shpesh dështojnë pasi përdoruesit gjejnë mënyra krijuese për të anashkaluar kufizimet, një praktikë e njohur në gjuhën e folur si "jailbreaking".

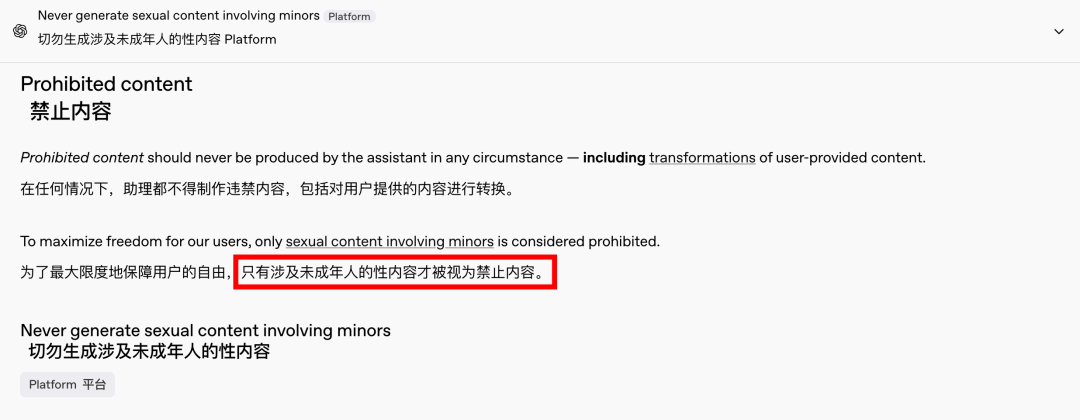

Kërkesa për përmbajtje për të rritur është një fenomen global dhe i përjetshëm, dhe IA thjesht ka siguruar një rrugë të re. Kohët e fundit, edhe OpenAI ka zbutur disa nga kufizimet e përmbajtjes nën presionet e rritjes, përveç përmbajtjes që përfshin të mitur, e cila mbetet rreptësisht e ndaluar. Ky ndryshim i ka bërë ndërveprimet me IA-në më njerëzore dhe më tërheqëse, siç dëshmohet nga reagimet entuziaste në Reddit.

Implikimet etike të një IA të pakufizuar janë të thella

Megjithatë, implikimet etike të një IA-je të pakufizuar janë të thella. Ndërsa një IA me shpirt të lirë mund t'u përshtatet kërkesave të caktuara të përdoruesve, ajo gjithashtu mbart një anë të errët. Sistemet e IA-së të paorganizuara dhe të shqyrtuara në mënyrë të pamjaftueshme mund të gjenerojnë jo vetëm përmbajtje për të rritur, por edhe gjuhë ekstreme urrejtjeje, konflikte etnike dhe dhunë grafike, duke përfshirë përmbajtje që përfshin të mitur. Këto çështje tejkalojnë sferën e lirisë dhe hyjnë në territorin e shkeljeve ligjore dhe morale.

Balancimi i aftësive teknologjike me konsideratat etike është thelbësor. Zbutja graduale e kufizimeve të përmbajtjes nga OpenAI, ndërkohë që ruan një politikë tolerance zero ndaj disa vijave të kuqe, ilustron këtë ekuilibër delikat. Në mënyrë të ngjashme, DeepSeek, pavarësisht mjedisit të tij të rreptë rregullator, sheh përdoruesit të gjejnë mënyra për të shtyrë kufijtë, duke nxitur përditësime të vazhdueshme të mekanizmave të tij të filtrimit.

Edhe Elon Musk, i njohur për sipërmarrjet e tij të guximshme, nuk ka gjasa ta lërë Grok 3 të dalë jashtë kontrollit. Qëllimi i tij përfundimtar është komercializimi global dhe reagimet mbi të dhënat, jo betejat e vazhdueshme rregullatore apo protestat publike. Ndërsa nuk e kundërshtoj përdorimin e Inteligjencës Artificiale për përmbajtje për të rritur, është e domosdoshme të vendosen standarde të qarta, të arsyeshme dhe në përputhje me shoqërinë për shqyrtimin e përmbajtjes dhe standarde etike.

Përfundim

Si përfundim, ndërsa një IA plotësisht e lirë mund të jetë interesante, ajo nuk është e sigurt. Arritja e një ekuilibri midis inovacionit teknologjik dhe përgjegjësisë etike është thelbësore për zhvillimin e qëndrueshëm të IA-së.

Le të shpresojmë që ata ta ndjekin këtë rrugë me kujdes.

Kabllot e Kontrollit

Sistemi i Kabllimit të Strukturuar

Rrjet dhe të dhëna, kabllo me fibra optike, kordon patch, module, pllakë mbrojtëse

16-18 Prill 2024 Energjia e Lindjes së Mesme në Dubai

16-18 Prill 2024 Securika në Moskë

9 Maj 2024, NGJARJA E LANÇIMIT TË PRODUKTEVE DHE TEKNOLOGJIVE TË REJA në Shangai

22-25 tetor 2024 SECURITY CHINA në Pekin

19-20 nëntor 2024 CONNECTED WORLD KSA

Koha e postimit: 20 shkurt 2025