Për BMS, BUS, Industriale, Kabllo Instrumentimi.

Elon Musk dhe ekipi i xAI lançuan zyrtarisht versionin më të fundit të Grok, Grok3, gjatë një transmetimi të drejtpërdrejtë. Përpara këtij eventi, një sasi e konsiderueshme informacioni të lidhur, së bashku me reklamimin 24/7 të Musk, rritën pritjet globale për Grok3 në nivele të papara. Vetëm një javë më parë, Musk deklaroi me besim gjatë një transmetimi të drejtpërdrejtë, ndërsa komentonte mbi DeepSeek R1, "xAI është gati të lançojë një model më të mirë të IA-së". Nga të dhënat e paraqitura drejtpërdrejt, Grok3 thuhet se ka tejkaluar të gjitha modelet aktuale kryesore në standardet për matematikën, shkencën dhe programimin, me Musk që madje pretendon se Grok3 do të përdoret për detyra llogaritëse që lidhen me misionet e SpaceX në Mars, duke parashikuar "përparime në nivelin e Çmimit Nobel brenda tre viteve". Megjithatë, këto janë aktualisht vetëm pohime të Musk. Pas lançimit, testova versionin më të fundit beta të Grok3 dhe bëra pyetjen klasike me hile për modelet e mëdha: "Cili është më i madh, 9.11 apo 9.9?" Fatkeqësisht, pa asnjë kualifikues ose vlerësim, i ashtuquajturi Grok3 më i zgjuar ende nuk mundi t'i përgjigjej saktë kësaj pyetjeje. Grok3 dështoi të identifikonte me saktësi kuptimin e pyetjes.

Ky test tërhoqi shpejt vëmendjen e konsiderueshme nga shumë miq, dhe rastësisht, teste të ndryshme të ngjashme jashtë vendit kanë treguar se Grok3 po përballet me vështirësi me pyetje themelore të fizikës/matematikës, si "Cili top bie i pari nga Kulla e Pjerrët e Pizës?". Kështu, është etiketuar me humor si "një gjeni që nuk dëshiron t'u përgjigjet pyetjeve të thjeshta".

Grok3 është i mirë, por nuk është më i mirë se R1 ose o1-Pro.

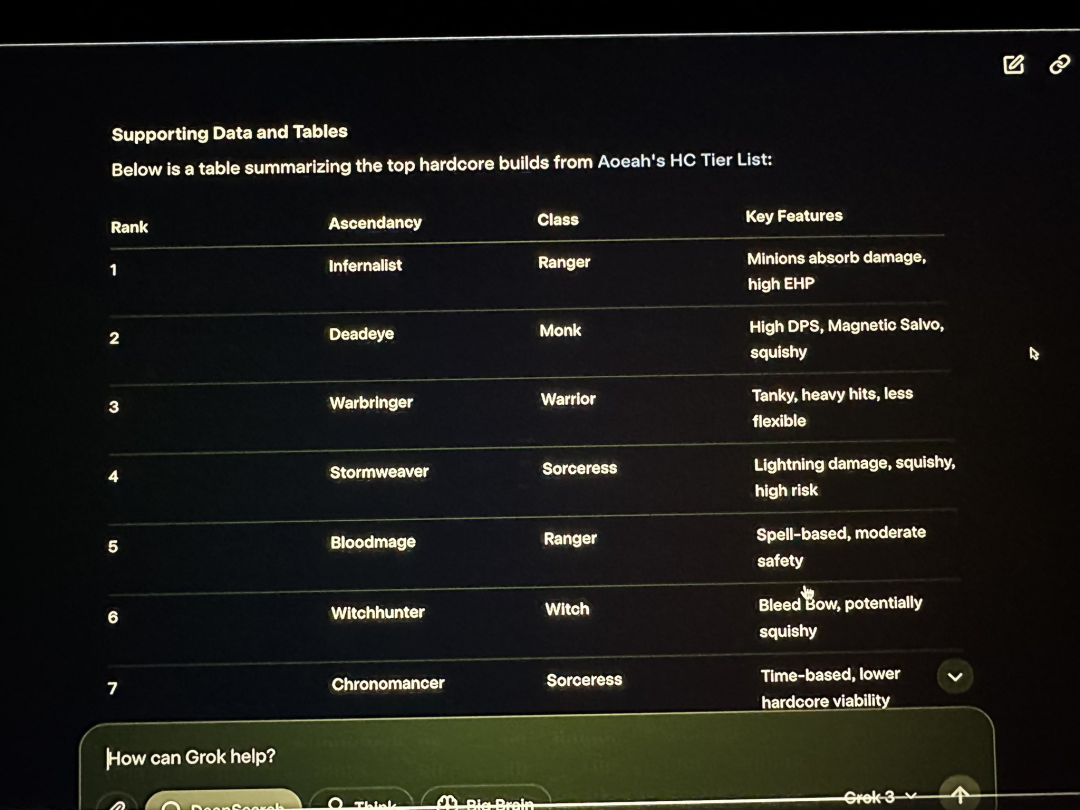

Grok3 përjetoi "dështime" në shumë teste të njohurive të zakonshme në praktikë. Gjatë eventit të lançimit të xAI, Musk demonstroi përdorimin e Grok3 për të analizuar klasat e personazheve dhe efektet nga loja Path of Exile 2, të cilën ai pretendoi se e luante shpesh, por shumica e përgjigjeve të dhëna nga Grok3 ishin të pasakta. Musk gjatë transmetimit të drejtpërdrejtë nuk e vuri re këtë problem të dukshëm.

Ky gabim jo vetëm që ofroi prova të mëtejshme që përdoruesit e internetit jashtë vendit ta tallnin Muskun për "gjetjen e një zëvendësimi" në lojëra, por gjithashtu ngriti shqetësime të konsiderueshme në lidhje me besueshmërinë e Grok3 në aplikimet praktike. Për një "gjeni" të tillë, pavarësisht nga aftësitë e tij aktuale, besueshmëria e tij në skenarë aplikimesh jashtëzakonisht komplekse, siç janë detyrat e eksplorimit të Marsit, mbetet në dyshim.

Aktualisht, shumë testues që morën akses në Grok3 javë më parë, dhe ata që testuan aftësitë e modelit për disa orë dje, të gjithë tregojnë një përfundim të përbashkët: "Grok3 është i mirë, por nuk është më i mirë se R1 ose o1-Pro".

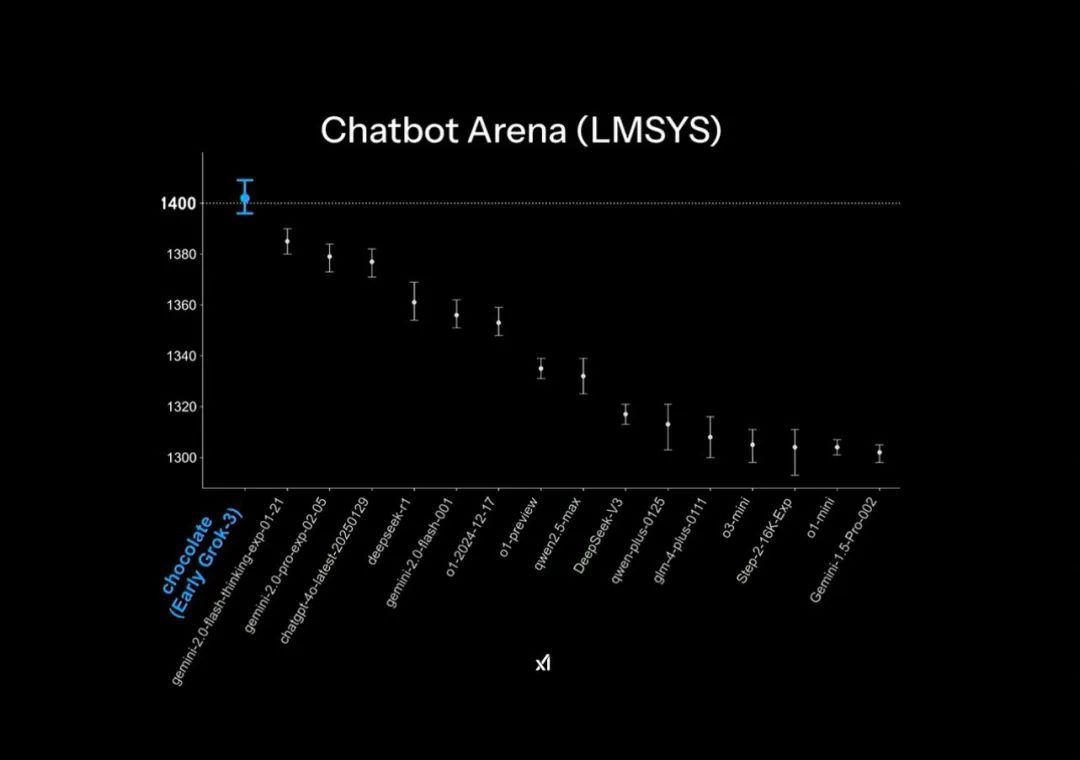

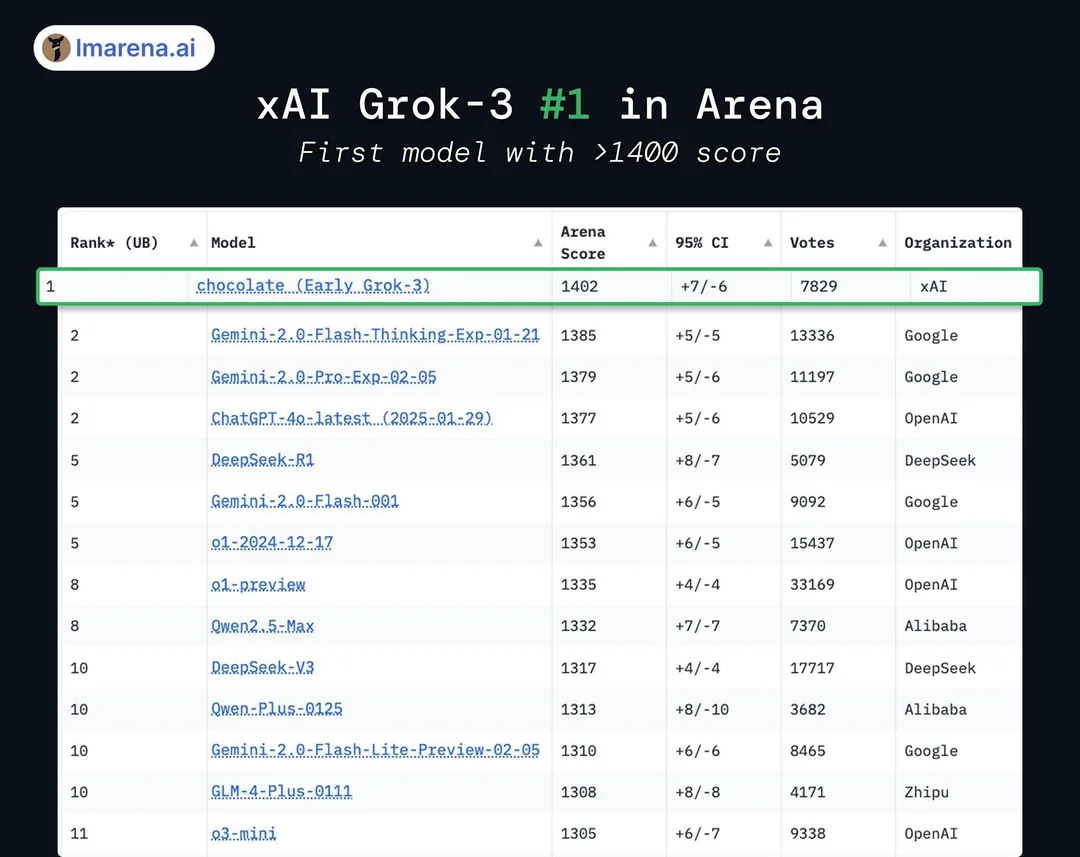

Një perspektivë kritike mbi "Shkatërrimin e Nvidia-së"

Në PPT-në e prezantuar zyrtarisht gjatë publikimit, Grok3 u tregua se ishte "shumë përpara" në Chatbot Arena, por kjo përdori me zgjuarsi teknikat grafike: boshti vertikal në tabelën e renditjes renditi vetëm rezultatet në diapazonin e rezultateve 1400-1300, duke e bërë ndryshimin origjinal prej 1% në rezultatet e testit të duket jashtëzakonisht i rëndësishëm në këtë prezantim.

Në rezultatet aktuale të vlerësimit të modelit, Grok3 është vetëm 1-2% përpara DeepSeek R1 dhe GPT-4.0, gjë që korrespondon me përvojat e shumë përdoruesve në testet praktike që nuk gjetën "asnjë ndryshim të dukshëm". Grok3 i tejkalon pasardhësit e tij vetëm me 1%-2%.

Edhe pse Grok3 ka marrë rezultate më të larta se të gjitha modelet e testuara publikisht aktualisht, shumë nuk e marrin seriozisht këtë: në fund të fundit, xAI është kritikuar më parë për "manipulimin e rezultateve" në epokën Grok2. Ndërsa tabela e renditjes penalizoi stilin e gjatësisë së përgjigjes, rezultatet ranë shumë, duke bërë që ekspertët e industrisë të kritikojnë shpesh fenomenin e "pikëzimit të lartë, por aftësisë së ulët".

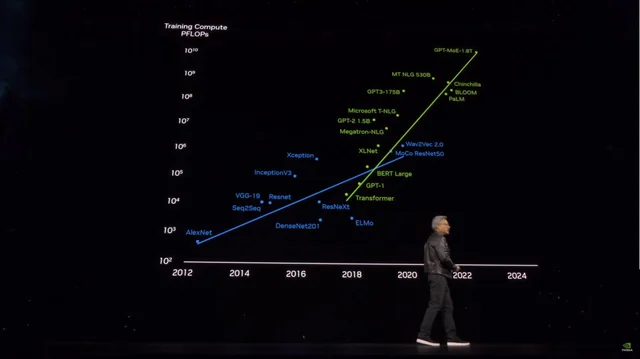

Qoftë përmes "manipulimit" të tabelës së renditjes apo trukeve të dizajnit në ilustrime, ato zbulojnë xAI dhe obsesionin e Musk me idenë e "udhëheqjes së grupit" në aftësitë e modelit. Musk pagoi një çmim të lartë për këto diferenca: gjatë lançimit, ai u mburr me përdorimin e 200,000 GPU-ve H100 (duke pretenduar "mbi 100,000" gjatë transmetimit të drejtpërdrejtë) dhe arritjen e një kohe totale trajnimi prej 200 milionë orësh. Kjo i bëri disa të besonin se kjo përfaqëson një tjetër ndihmë të rëndësishme për industrinë e GPU-ve dhe ta konsideronin ndikimin e DeepSeek në sektor si "budallallëk". Veçanërisht, disa besojnë se fuqia e pastër llogaritëse do të jetë e ardhmja e trajnimit të modeleve.

Megjithatë, disa përdorues të internetit krahasuan konsumin e 2000 GPU-ve H800 gjatë dy muajve për të prodhuar DeepSeek V3, duke llogaritur se konsumi aktual i energjisë stërvitore të Grok3 është 263 herë më i lartë se ai i V3. Hendeku midis DeepSeek V3, i cili shënoi 1402 pikë, dhe Grok3 është pak më pak se 100 pikë. Pas publikimit të këtyre të dhënave, shumë veta e kuptuan shpejt se pas titullit të Grok3 si "më i forti në botë" fshihet një efekt i qartë i dobisë margjinale - logjika e modeleve më të mëdha që gjenerojnë performancë më të fortë ka filluar të tregojë kthime në rënie.

Edhe me "vlerësim të lartë, por aftësi të ulët", Grok2 kishte sasi të mëdha të dhënash të palës së parë me cilësi të lartë nga platforma X (Twitter) për të mbështetur përdorimin. Megjithatë, në trajnimin e Grok3, xAI hasi natyrshëm "tavanin" me të cilin përballet OpenAI aktualisht - mungesa e të dhënave të trajnimit premium ekspozon shpejt dobinë margjinale të aftësive të modelit.

Zhvilluesit e Grok3 dhe Musk janë ndoshta të parët që i kuptojnë dhe i identifikojnë këto fakte në thellësi, prandaj Musk ka përmendur vazhdimisht në mediat sociale se versioni që përdoruesit po përjetojnë tani është "ende vetëm beta" dhe se "versioni i plotë do të publikohet në muajt në vijim". Musk ka marrë rolin e menaxherit të produktit të Grok3, duke u sugjeruar përdoruesve të japin reagime mbi probleme të ndryshme që hasen në seksionin e komenteve. Ai mund të jetë menaxheri i produktit më i ndjekur në Tokë.

Megjithatë, brenda një dite, performanca e Grok3 padyshim ngriti alarme për ata që shpresojnë të mbështeten në "muskuj masivë llogaritës" për të trajnuar modele të mëdha më të forta: bazuar në informacionin publik të disponueshëm nga Microsoft, GPT-4 i OpenAI ka një madhësi parametri prej 1.8 trilion parametrash, mbi dhjetë herë më shumë se GPT-3. Thashethemet sugjerojnë se madhësia e parametrit të GPT-4.5 mund të jetë edhe më e madhe.

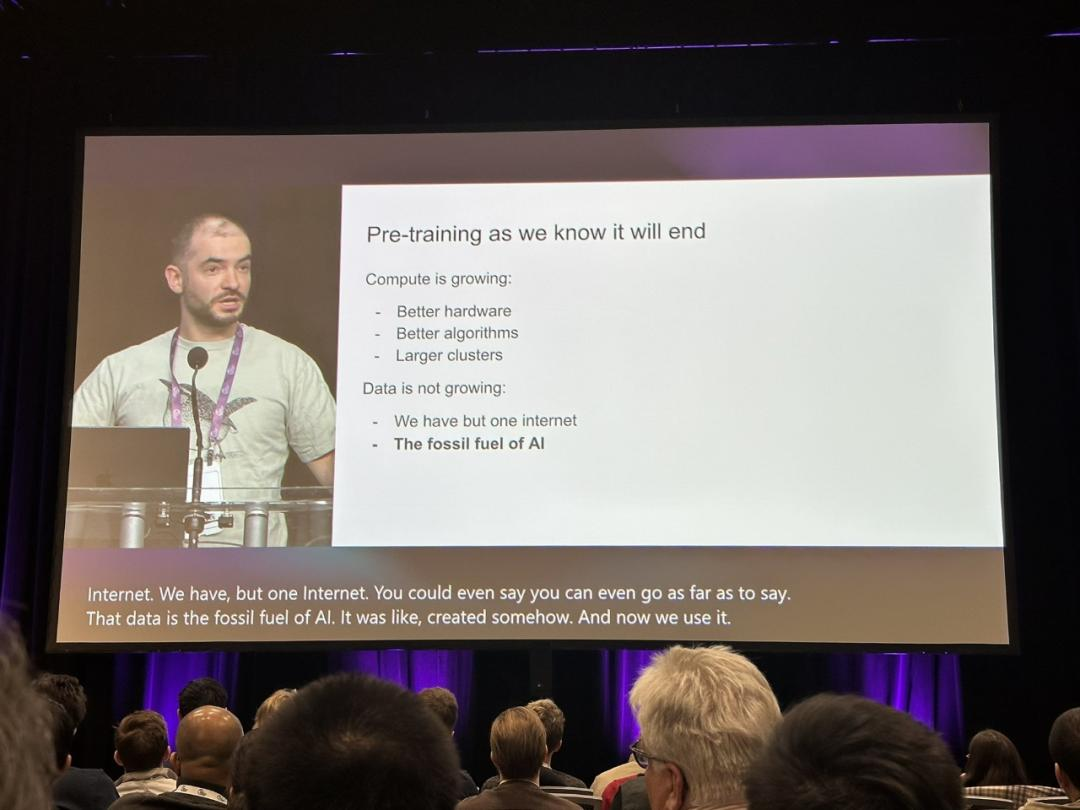

Ndërsa madhësitë e parametrave të modelit rriten ndjeshëm, edhe kostot e trajnimit po rriten ndjeshëm. Me praninë e Grok3, konkurrentë si GPT-4.5 dhe të tjerë që dëshirojnë të vazhdojnë të "shpenzojnë para" për të arritur performancë më të mirë të modelit përmes madhësisë së parametrave duhet të marrin në konsideratë kufirin që tani është qartësisht në horizont dhe të mendojnë se si ta kapërcejnë atë. Në këtë moment, Ilya Sutskever, ish-shkencëtar kryesor në OpenAI, kishte deklaruar më parë dhjetorin e kaluar, "Trajnimi paraprak me të cilin jemi të njohur do të marrë fund", gjë që është rishfaqur në diskutime, duke nxitur përpjekje për të gjetur rrugën e vërtetë për trajnimin e modeleve të mëdha.

Pikëpamja e Ilyas ka dhënë alarmin në industri. Ai parashikoi me saktësi shterimin e menjëhershëm të të dhënave të reja të arritshme, duke çuar në një situatë ku performanca nuk mund të vazhdojë të përmirësohet përmes mbledhjes së të dhënave, duke e krahasuar atë me shterimin e lëndëve djegëse fosile. Ai tregoi se "ashtu si nafta, përmbajtja e gjeneruar nga njeriu në internet është një burim i kufizuar". Në parashikimet e Sutskever, gjenerata e ardhshme e modeleve, pas trajnimit paraprak, do të posedojë "autonomi të vërtetë" dhe aftësi arsyetimi "të ngjashme me trurin e njeriut".

Ndryshe nga modelet e sotme të para-trajnuara që mbështeten kryesisht në përputhjen e përmbajtjes (bazuar në përmbajtjen e modelit të mësuar më parë), sistemet e ardhshme të IA-së do të jenë në gjendje të mësojnë dhe të krijojnë metodologji për të zgjidhur problemet në një mënyrë të ngjashme me "të menduarit" e trurit të njeriut. Një njeri mund të arrijë aftësi themelore në një lëndë vetëm me literaturë bazë profesionale, ndërsa një model i madh i IA-së kërkon miliona pika të dhënash për të arritur vetëm efikasitetin më themelor të nivelit fillestar. Edhe kur formulimi ndryshohet pak, këto pyetje themelore mund të mos kuptohen saktë, duke ilustruar se modeli nuk është përmirësuar vërtet në inteligjencë: pyetjet themelore, por të pazgjidhshme të përmendura në fillim të artikullit, përfaqësojnë një shembull të qartë të këtij fenomeni.

Përfundim

Megjithatë, përtej forcës brutale, nëse Grok3 me të vërtetë arrin t'i zbulojë industrisë se "modelet e para-trajnuara po i afrohen fundit të tyre", kjo do të kishte implikime të rëndësishme për këtë fushë.

Ndoshta, pasi të qetësohet gradualisht gjithë ajo entuziazëm që rrethon Grok3, do të shohim më shumë raste si shembulli i Fei-Fei Li-t për "akordimin e modeleve me performancë të lartë në një grup të dhënash specifik për vetëm 50 dollarë", duke zbuluar në fund rrugën e vërtetë drejt IGA-së.

Kabllot e Kontrollit

Sistemi i Kabllimit të Strukturuar

Rrjet dhe të dhëna, kabllo me fibra optike, kordon patch, module, pllakë mbrojtëse

16-18 Prill 2024 Energjia e Lindjes së Mesme në Dubai

16-18 Prill 2024 Securika në Moskë

9 Maj 2024, NGJARJA E LANÇIMIT TË PRODUKTEVE DHE TEKNOLOGJIVE TË REJA në Shangai

22-25 tetor 2024 SECURITY CHINA në Pekin

19-20 nëntor 2024 CONNECTED WORLD KSA

Koha e postimit: 19 shkurt 2025